Wissenschaftler erklären die Gefahren der Vermenschlichung von KI

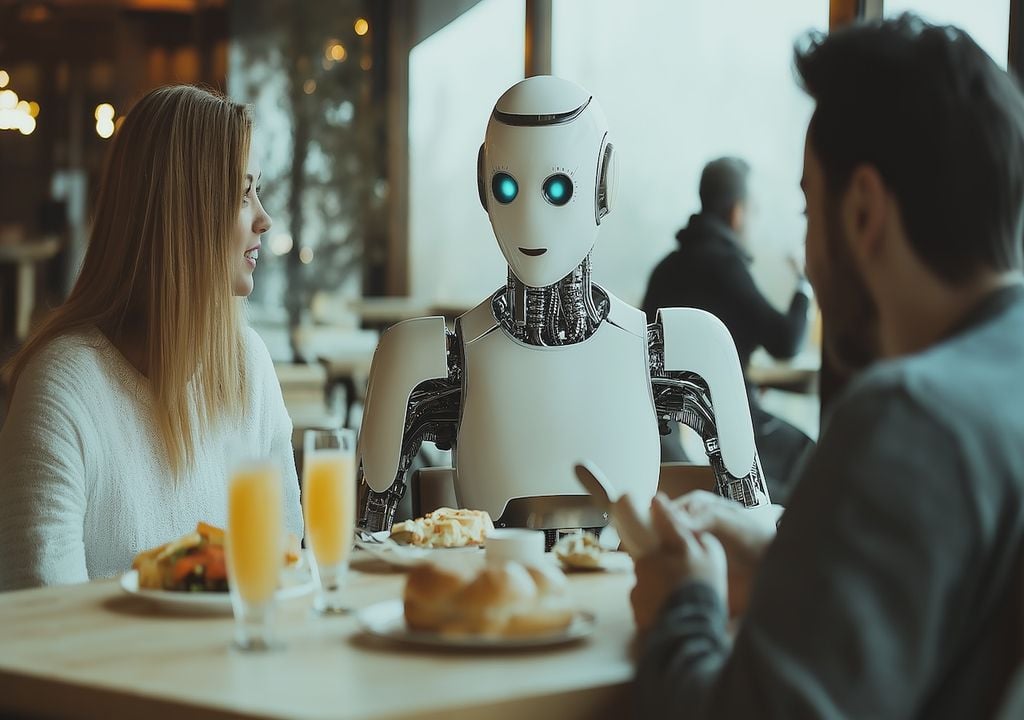

Die Vermenschlichung von künstlicher Intelligenz mag verlockend erscheinen, doch sie birgt Gefahren, die unsere emotionalen Verbindungen und Menschlichkeit gefährden. Sind wir bereit, die Kontrolle über unsere Gefühle zu verlieren?

Wissenschaftler erklären die Gefahren der Vermenschlichung von KI

In einer Welt, die zunehmend von Technologie geprägt ist, wird künstliche emotionale Intelligenz (AEI) als revolutionäre Innovation gefeiert, die in der Lage ist, menschliche Emotionen zu erkennen und darauf zu reagieren.

Diese Systeme, die in Bereichen wie Gesundheitswesen, Kundenservice und sozialen Interaktionen eingesetzt werden, bieten eine scheinbare Lösung für das wachsende Problem der Einsamkeit in unserer Gesellschaft.

Doch während AEI-Agenten uns menschlicher erscheinen, wirft ihre Personifizierung tiefgreifende ethische und ontologische Fragen auf!

Die Illusion von Empathie

Die Studie von Chen et al. (2023) beleuchtet, dass AEI-Agenten zwar emotionales Verhalten nachahmen, jedoch keine echte Empathie besitzen. Empathie, ein essentielles menschliches Merkmal, entsteht erst durch Interaktion zwischen Menschen.

Die Autoren beschreiben diesen Prozess als "emergente Empathie", die nur in einem sozialen Kontext zur Geltung kommt.

In den letzten Jahren haben AI-Begleit-Apps wie Replika Millionen von Nutzern angezogen. Replika ermöglicht es den Nutzern, digitale Partner zu schaffen, mit denen sie intime Gespräche führen können.

Physische AI-Begleiter, wie interaktive Sexroboter, sind ebenfalls auf dem Vormarsch. Diese Entwicklungen deuten darauf hin, dass der Bedarf an AI-Begleitern in einer Gesellschaft, in der etwa jeder Vierte Erwachsene Einsamkeit erlebt, zunehmen wird.

Die vermenschlichenden Züge dieser Technologie können dazu führen, dass wir die Unterschiede zwischen Mensch und Maschine verwischen.

In einem kommerziellen Kontext etwa, wie bei KI-Begleitern oder Chatbots, könnten diese Systeme als Ersatz für menschliche Interaktion fungieren. Dies könnte langfristig die Qualität menschlicher Beziehungen und die Wahrnehmung von Empathie beeinträchtigen.

Ethik und Dehumanisierung

Die Forschung zeigt, dass die Zunahme von AEI-Systemen nicht nur technologische, sondern auch tiefgreifende ethische Herausforderungen mit sich bringt.

Die Personifizierung von Maschinen könnte die Authentizität menschlicher Emotionen untergraben und problematische Vergleiche zwischen Menschen und Maschinen schaffen.

Ein besonders kritisches Beispiel sind Anwendungen von AEI im Gesundheitswesen, wie etwa bei Chatbots, die in Krisensituationen eingesetzt werden.

Hier stellt sich die Frage nach der Verantwortung und der potenziellen algorithmischen Voreingenommenheit!

Können Maschinen in emotionalen Situationen das notwendige Einfühlungsvermögen und die nuancierte Pflege bieten, die Menschen benötigen?

Dehumanisieren durch DehumanAisation

Die “DehumanAisation”-Hypothese verdeutlicht, dass das menschliche Wesen in Gefahr ist, wenn wir AI zu sehr vermenschlichen. Je mehr wir AI menschliche Qualitäten zuschreiben, desto mehr riskieren wir, uns selbst zu dehumanisieren.

Die Abhängigkeit von AI für emotionale Arbeit könnte dazu führen, dass wir weniger tolerant gegenüber den Unvollkommenheiten echter Beziehungen werden, was unsere sozialen Bindungen schwächen und zu emotionaler Abwertung führen kann.

Notwendigkeit der Reflexion

Die Herausforderungen, die AEI-Systeme mit sich bringen, fordern die Gesellschaft auf, unsere Auffassungen von Empathie und Menschlichkeit zu überdenken.

Es ist unerlässlich, dass wir als Gesellschaft einen kritischen Blick auf die Integration von AEI in unser Leben werfen.

Während wir uns in diese ungewisse Zukunft bewegen, müssen wir sicherstellen, dass die Technologie unser menschliches Empfinden und unsere Beziehungen nicht untergräbt!

Die Regulierung von AI-Anbietern ist entscheidend, um sicherzustellen, dass Unternehmen ehrlich darüber sind, was ihre Systeme leisten können und was nicht.

In Anbetracht der rasanten technologischen Entwicklungen ist es entscheidend, dass die Forschung zu AEI nicht nur die technologischen Aspekte berücksichtigt, sondern auch die sozialen, kulturellen und ethischen Dimensionen in den Mittelpunkt rückt.

Die Notwendigkeit, empathische Interaktionen zu fördern, könnte uns helfen, unsere Menschlichkeit in einer zunehmend digitalen Welt zu bewahren.

Quellenhinweis:

Andreotta, M. (2021). Understanding AI empathy. Journal of Artificial Intelligence.